AI影像时代的公共卫生焦虑-感染性媒介与幻觉失乐园

(复旦大学中国语言文学系, 上海 200433)

摘要: 现代人工智能 (AI) 的迅猛发展, 使寓言性的“人工生命”神话具象化为现实技术, 催生出一种新的视觉生态与媒介环境。不过, 影像生成机制也感染了AI影像的神经回路, 这种感染体现为训练集里偏见、碎片与意识形态残留所导致的媒介病理性症候, 进而引发一场前所未有的公共卫生焦虑。通过分析ImageNet训练集、特雷弗·帕格伦的艺术作品以及Sora的影像生成实验, 还可进一步见出, 算法内部自我生成的“合成数据”携带某种结构性缺陷, 使模型陷入“过拟合”的幻觉再生产。我们仿佛被卷入一个由“幻觉失乐园”缔造的舒适的恐怖谷中。在此境况下, 对AI逻辑的抵抗显得愈发无力, 而尚未被算法污染的“净土”亦将在可预见的未来难以寻觅。

关键词: 人工智能, AI影像, AI幻觉, 特雷弗·帕格伦, 合成数据

引用格式: 周厚翼. AI影像时代的公共卫生焦虑———感染性媒介与幻觉失乐园[J]. 艺术学研究进展, 2025, 2(2): 186-197.

文章类型: 研究性论文

收稿日期: 2025-04-21

接收日期: 2025-06-07

出版日期: 2025-06-28

1 从理念到数据:人工智能与“思想-影像”的转向

在《神与机器人:神话、机器和古老的科技梦想》(Gods and Robots:Myths,Machines,and Ancient Dreams of Technology,2018)一书中,艾德里安·梅尔(Adrienne Mayor)指出,人类对人工智能的想象可追溯至古代,即人工智能被构想为一种理想形式的“神话”或说“愿望”。这一渴望深植于神话叙事对“可控智能生命”的构想与由此引发的文化焦虑中。以古希腊神话为例,塔洛斯(Talos)与潘多拉(Pandora)可被视为“人工生命”概念的最早模型。塔洛斯是工艺之神赫菲斯托斯(Hephaestus)所创造,他是一位青铜铸成的巨人,具有“自动性”的行为逻辑,负责巡逻克里特岛(Crete)以防御外敌,可谓“最早行走在地球上的‘机器人’”[1]27-28。塔洛斯体型巨大,体内贯通一根从头至脚的管道,其中流淌着希腊人称为“神性脓液”(ichor)的生命之源。在《阿尔戈英雄纪》(Argonautica)里,女巫美狄亚(Medea)拔掉了塔洛斯脚踝处的螺栓,导致他的能量系统崩溃,最终脓液外泄而亡。[1]31-32这一情节折射出古人对于人工生命的脆弱性与失控风险的朴素认知。

潘多拉最早见于赫西俄德(Hesiod)的《神谱》(Theogony)与《工作与时日》(Works and Days)。潘多拉意为“万物之礼”,是神话中首位被赋予生命的“女性机器人”。与塔洛斯不同,潘多拉的存在并非为了执行保护任务,而是被设计为灾厄的引发者。她携带着一个封存了疾病、衰老与精神错乱的罐子,由宙斯精心构思并“程序化”地派遣至人类世界,她的唯一使命即释放“罐中恶灵”。[1]156梅尔认为,这种具有预设任务并以破坏形式执行任务的模式,使潘多拉可被视为神话意义上的“人工智能代理”(AI agent)。此外,潘多拉的女性身份与技术化身体的结合,也揭示了人类文化中持续存在的对技术性“他者”可能构成威胁的焦虑。

塔洛斯和潘多拉作为人工智能理念的具象化“代理”而存在,二者或代表保护性的“善”,或象征破坏性的“恶”,亦可被视为某种嵌入程序控制的原型(prototype)。塔洛斯的“死亡”与潘多拉的“魔盒”则构成了古代神话对未来技术的早期思想实验与情景假设,这不仅提出了“人为造物”的哲学命题,我们也由此得以读解出关于现代人工智能的某种寓言性意涵:造物的目的性、潜在失控的危险性,以及人类对其创造物深层的心理焦虑。而神话图景始终作为“技术现实”的先行模型,不断被挪用、转化与重演:人工智能神话不仅为现代人工智能技术提供了某种叙事母题和文化语境,现代人工智能则将“人为造物”这一理念想转化为现实结构。1956年,约翰·麦卡锡(John McCarthy)等人在达特茅斯会议中正式提出“人工智能”概念。①原属神话与哲学范畴的“能思考的机器(thinking machines)”,逐渐被确立为一个具备理论路径与技术方案的研究领域。②1979年,逻辑学家罗伯特·科瓦尔斯基(Robert Kowalski)提出“算法=逻辑+控制”[2]这一著名等式,此公式在计算机科学界获得广泛认同。它表明:算法可以被视为一组结合逻辑推理与场景控制的操作指令,旨在引导计算系统完成具体任务。这一公式构成理解AI系统架构的基础模型,同时隐含着与神话中AI原型相似的结构性思维图式:其中,“逻辑”对应人工智能的架构本质,“控制”则定义其执行路径,二者结合构成可运作的智能系统。这一结构性逻辑,正与赫菲斯托斯对塔洛斯“控制结构”的神话性设定,以及宙斯对潘多拉“预设程序”的叙事设计形成某种互文关系。现代人工智能被归于一般性算法类别汇总的特定子类,旨在通过机器(尤其是计算机系统)模拟一系列原本需要人类智能才能完成的复杂任务,例如分析、推理、决策及自然语言处理(Natural Language Processing,简称NLP)等。这种以数理逻辑为核心的技术路线,本质上延续了以阿兰·图灵(Alan Turing)与冯·诺依曼(John von Neumann)为代表的逻辑主义传统。[3]

直到生成式人工智能(Generative Artificial Intelligence,简称AIGC或GenAI)的兴起,AI才真正完成了从理念模型向经验世界(语言模型与视觉模型)的根本性转向。生成式AI的核心能力在于对大规模数据集(data set)进行训练与再现,它直接嵌入人类生活世界,获得了思考、言说、再现世界的复合能力。生成式AI的理论雏形虽可追溯至20世纪末,但真正的技术飞跃始于2017年谷歌提出的Transformer架构,这为多模态生成模型奠定了方法论基础。在语言模型领域,2022年,OpenAI发布ChatGPT,推动微软(Copilot)、谷歌(Gemini)、Anthropic(Claude)、Meta(LLaMA)等机构迅速展开大型语言模型的技术竞逐。在视觉模型领域,2014年计算机科学家伊恩·古德费洛(Ian Goodfellow)提出的生成对抗网络(Generative Adversarial Networks,简称GANs),推动了人工智能从影像识别迈向影像生成的转折;随后发展出的扩散模型(Diffusion Models),如Stable Diffusion,进一步实现了“文本到影像”的高保真度生成。所有这一切的基础都是庞大的数据集——数据集构成了生成式AI的核心媒介源,为人工智能如何识别、解释,乃至“创造”世界中的语言与图像提供了根本前提。

在这一背景下,影像生成的根基已发生质性跃迁。在一个强调影像作为“理念再现”(representation of idea)而非“机械复制”(mechanical reproduction)的古典时代,捕捉并定格“唯美”(le beau)始终是一项艰难且崇高的使命。围绕绘画、舞蹈与早期光学摄影的诸多研究中,“姿势”(gesture)成为反复探讨的核心问题:它凝结了某一被认为优越、纯粹乃至超验的瞬间,并由此赋予这一瞬时超越日常流逝的象征性权力。在以“再现”为范式的古典美学系统中,几乎所有艺术形式都围绕“特权瞬间”(les instants privilégiés)建构——唯有在这样的瞬间,永恒的理念秩序方能显现[4]13,这正是现象世界对形而上学秩序的不断渴望。绘画定格了模特最优美的情态,舞蹈的“停顿”标志着身体形式的臻至极致——此时,主体在被光线照亮的瞬间成为理念显现的通道,一种更高悬的、更优越的秩序似乎由艺术家从经验时空中“凿”出。

瓦尔特·本雅明(Walter Benjamin)在《摄影小史》(Kleine Geschichte der Photographie,1931)中指出:“人们相信,那些被摄入相机的细小形象,正如某些原始民族所迷信的影子乃至灵魂一样,会夺取被摄对象的某种本质。”[5]这一民间迷信反映了公众对于光学定格技术所潜藏的“形而上学能力”的不安。无论是绘画、舞蹈中对于“特权瞬间”的凝滞,还是民众对“摄影窃取灵魂”的不安,本质上都指向一种垄断性的美学权力结构:艺术家作为撷取理念世界的“神性中介”(divine intermediary),通过对特权瞬间的把握,为表象世界赋予永恒的观念秩序。电影的出现最早动摇了这一对“神经秩序”和“特权瞬间”的垄断。尽管电影延续了光学镜面(optical glass)与摄影术的技术谱系,但它所引入的是一种以每秒24帧等距节奏记录“任意瞬间”(l’instant quelconque)的影像形式。作为“即时快照”(la photo instantanée),电影“在任何时刻的机械顺序”(la succession mécanique)都取代了“姿势”的辩证秩序(l’ordre dialectique)。[4]12,14换言之,电影打破了影像为理念服务的美学结构,使“瞬间”脱离特权的位置,转而构成一种非层级化的时间经验。随着那种附着于“姿势”的理念美学被一并拉下神坛,影像也从一种摹写理念的“再现手段”退化为可被技术性地记录、复制与放映的时间性物料,“唯美”失去了形而上学的优越地位。

借助数字相机与算法生成工具所转码的图像,更不需要依赖胶片颗粒这类物质基质,而是建立在可编码的像素符号与数据结构之上——这些结构由能源和电力驱动。自1990年代以来,数字影像与计算机成像(Computer-Generated Imagery,简称CGI)逐渐主导了视觉文化结构。与此同时,算法对影像的数据攫取(data acquisition)与风格迁移(style transfer)机制,使得“完美姿势”或“唯美瞬间”被简化为一种词元(token)层级上的计算过程。在这一自动化流程中,算法基于数据运作,又不断产生新的数据,就像一个闭路电流系统,没有光学机制参与的空间。“任意瞬间”已不再具有独特性了,因为它们彻底放弃了其前身(“特权瞬间”)对“完美”或“真理瞬间”的执念,转而成为某种“一般等价物”式的数据堆栈:无限可复制、流通、模拟、重组,并随时被算法调用与篡改。由此,影像生成逻辑的演进最终彻底改变了人类理解“视觉”的方式本身。

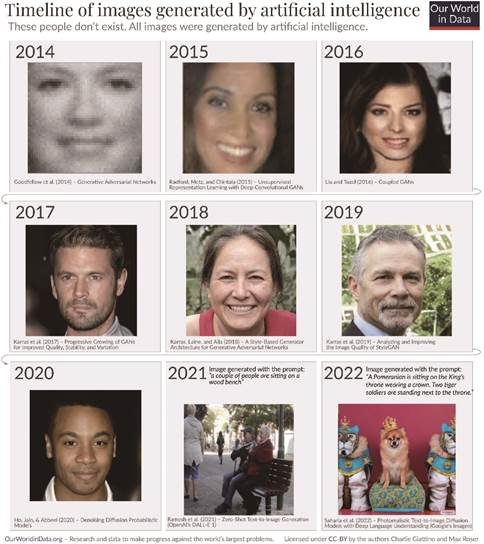

麦克斯·罗瑟(Max Roser)通过九张代表性图像作品,梳理了2014至2022年间AI在影像生成领域的技术演进时间线(图1)。该系列以左上角一张粗粝的图像开篇:一幅黑白像素化人脸,作为早期AI视觉想象力的原始模型。而到了2022年,即使面对“博美犬戴着王冠坐在宝座上,两侧各站立一只老虎士兵”这样高度复杂的提示语,AI系统也已能在数秒内生成高度现实感的图像。[6]可见,语言描述所激发的影像再现力,已从“稚拙”跃迁至“拟真”。人工智能在语言与视觉之间的联动呈指数级跃进:大型语言模型(Large Language Models,简称LLMs)经由海量训练数据与复杂算法训练,已具备生成文本、回答提问乃至执行复杂任务的能力;进一步地,这些语言模型还能通过视觉模型完成从语词到图像的跨模态生成,构建出具有语义一致性与视觉细节的AI影像(AI-generated images)。如今,AI影像广泛应用于概念艺术、分镜脚本、虚拟场景与视觉特效的创作实践中。在犹太傀儡神话中,人们通过神秘的仪式与言语——例如将刻有上帝之名(shem)的纸条嵌入傀儡口中——为泥塑的人赋予生命。③而生成式AI似乎实现了傀儡神话中这种语言催生生命的惊叹能力,成为现代技术语境中的“傀儡术者”:“语言是动画师(animator)——将泥塑变成生命的要素。”[7]

德勒兹在《电影2:时间-影像》(Cinéma 2:L’image-temps,1985)中再度阐释了“思想”与“影像”的关系,提出区别于其早期在《差异与重复》(Différence et Répétition,1968)中作为观念投射的、教条性的“思想的影像(l’image de la pensée)”[8]的另一种思考模式:“思想-影像”。“思想-影像”意味着影像不再是运动的附庸,而直接触及时间、与思想、精神等维度。这一概念甚至可进一步推演为“思想即影像”的强联结公式——影像作为一种全新的思考模式,它能触及到思想不可思考之处,使“真正的思想”得以呈现。如今,借助大数据训练集、大语言模型和CGI技术,AI影像某种意义上已将德勒兹的“思想即影像”命题现实化。这不仅提供了一种新的可视性机制,更转写了“思考”的逻辑结构——它让思想的复杂性、潜在性、不确定性获得了瞬时成像的能力。

图1 2014年至2022年AI影像生成技术的发展时间线,展示了从早期像素化人脸到复杂场景生成的技术进步[6]

Fig.1 Timeline of AI-generated image development from 2014 to 2022,illustrating the progression from early pixelated faces to complex scene generation

然而,这种技术化的“思想-影像”联结同时也将我们推入一个彻底陌异(altérité)的思维地景。斯坦利·库布里克(Stanley Kubrick)在《2001:太空漫游》(2001:A Space Odyssey,1968)中预示了技术世界的尽头。这部被展演到极致的“大脑电影”,不仅设想了一个彻底工具理性的世界,也预告了传统意义上“思想-影像”关系的终结:思想一方面展现出跨越宇宙的潜能,另一方面却在极端理性化的推进中将一切生机毁灭,使时空归于“热寂”。现实中的生成式AI并未像电影中的AI系统“哈尔9000”(HAL 9000)那样,等待被更为冷静自持的人类思想“关机”,而是不断基于数据集重新学习“思想”、重新组织“影像”,人类似乎已经无法将其“关机”。因为在这一过程中,AI系统的自生成机制将“思想”与“影像”的互动引导入一个彻底的“黑洞”。“黑洞”首先意味着AI影像对“可见性”的反叛:作为再现艺术源头的物理光源被排除于影像生成之外。“黑洞”也象征着AI生成机制本身的悖论性挑战:现代人工智能和神经网络的高度复杂性甚至对其创造者来说也是不可理解的,其内部结构似乎潜藏着一种近乎“僭主式”的权力形态。神经网络的复杂性已超出人类的认知边界,无论是普通用户还是算法平台的开发人员,都无法完全理解其内部运作的黑箱逻辑;并且,AI模型在反馈过程中形成的推理错误与认知偏差已不再是可被定位并修复的“bug”,开发者只能通过扩大训练数据集或提升训练频率来进行有限的调节。

这一生成机制正在深刻质疑技术主导下视觉经验的本质。如果古典再现影像植根于理念、光、神话与洁净秩序,那么AI影像则源自纷繁的数据流。如果我们坚持人工智能的原生形态,即囿于逻辑理念之中,那么它不应具备生成影像的能力,而是人类创造影像去摹刻它的可感表象。所以,影像也本应与AI存在“楚河汉界”,如果真的有“AI影像”,那么也是德勒兹所谓的“思想的影像”——一种摹仿、再现理念的概念性作品。然而现实却截然相反:生成式AI与大数据已被广泛视为天然的联动者。AI影像依托原始数据集,借助生成对抗网络(GANs)、变分自编码器(VAEs)与扩散模型(diffusion models)等技术,从文本描述或既有图像中生成新的视觉形态。数据的体量、流速与多样性共同塑造着最终的生成效果,逐步瓦解了影像的传统再现逻辑,使AI影像不再体现依托光学与现实的“索引性”(indexicality),转向一种彻底由算法重塑感知、再造可见性的思想景观。

2 媒介的感染性隐喻:从“苹果”到“异常”

从某种意义上说,AI影像对理念的光学背离,是数据与理念碰撞的必然后果。数据的不洁性侵染了理念的纯净结构,改变了人工智能的本质特性,也引发了一场前所未有的“公共卫生”(public health)危机。传统上,“公共卫生危机”指传染病暴发、环境污染或其他健康威胁所导致的,对群体健康和社会秩序产生大范围冲击的紧急状态。这类危机通常涉及疾病传播速度、医疗资源紧张、社会恐慌与制度性应对失效等层面。如今,“公共卫生”亦可作为一个隐喻,用以描述AI算法时代影像生成中的“不洁症候”。AI影像中潜藏的“病灶”在视觉、认知与情感层面诱发了扩散性的文化与心理焦虑。这种焦虑不仅反映了人们对技术偏见和数据污染的生理,更与古老神话中关于人工生命的想象形成共振,象征着人们对未来的“失控感”,以及对影像“洁净感”和主体“独立性”逐步流失的深层恐惧。

ImageNet作为AI视觉史的重要节点,在计算机视觉(Computer Vision)领域奠定了深远的技术与符号基础。该项目由李飞飞(Fei-Fei Li)等于2009年启动,旨在构建一个基于WordNet语义结构的超大规模影像训练集。[9]这一训练集涵盖逾两万个类别、累计超过一千四百万张影像,为机器学习模型,特别是卷积神经网络(Convolutional Neural Networks,简称CNNs)的训练与评估,提供了前所未有的标准化基准。④自2012年AlexNet在ImageNet大规模视觉识别挑战赛(ImageNet Large Scale Visual Recognition Challenge,简称ILSVRC)中取得突破性成果以来,深度学习(Deep Learning)迅速确立了在影像识别中的统治地位,ImageNet也随之被视为深度学习“奇点”(singularity)的关键催化剂。然而,ImageNet并非一个理想化的、中性的数据容器,而是一套混杂着色情、暴力与低像素图像的“视觉碎片”(visual debris)堆积体。这些影像既是网络无意识的沉积物,也包含着大量早期网络空间大量存在的边缘化内容。所有影像都被系统性地标注与分类,标注与分类十分繁复。例如,“苹果”(apple)不仅指涉果实本身,还涵盖“苹果馅饼”“苹果锈病”“苹果蛆虫”“苹果车”“苹果蚜虫”等一系列异质图像标签,呈现出一种近乎病态的标签泛滥。

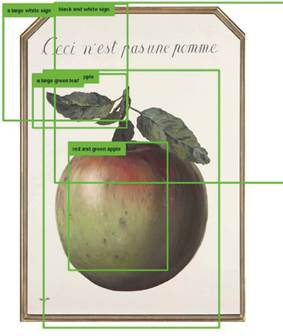

帕格伦正是在此语境中创作了影像装置作品《从“苹果”到“异常”》(From“Apple”to“Anomaly”,2019)。他从ImageNet训练集中提取三万张影像,通过巨幅屏幕展陈这些图像在算法语义链接与漂移中,如何从日常的“苹果”滑向陌异的“异常”。帕格伦巧妙借用了超现实主义画家雷内·马格利特(René Magritte)的经典作品《这不是一个苹果》(Ceci n’ est pas une Pomme,1929)作为视觉与理论索引,与AI训练集影像并置展开。有趣的是,帕格伦曾在另一作品中展示AI对马格利特“苹果”的判读:“一个红绿相间的苹果”——“一个高效却冷漠的断语,无须解释,也拒绝歧义。”[10](图2)那么,影像如何在机器的统计聚类、语义联想与抽象归纳的操作中,从寻常事物转化为难以辨识的异常?这成为帕格伦关注的核心问题(图3、图4)。

图2 帕格伦工作室的研究图像,展示了计算机视觉对《这不是一个苹果》的解读

Fig.2 Paglen’s Studio research image showing how computer vision interprets Ceci n’est pas une Pomme

图3 《从“苹果”到“异常”》(a),将雷内·马格利特1964年画作《这不是一个苹果》与训练集影像并置

Fig.3 From“Apple”to“Anomaly”(a),juxtaposes René Magritte’s 1964 painting Ceci n’est pas une Pomme with training set images

图4 《从“苹果”到“异常”》(b),展示了ImageNet中从“苹果”到“异常”标签的影像滑移

Fig.4 From“Apple”to“Anomaly”(b),demonstrating the image slippage from“apple” to “anomaly” in ImageNet

在此,“苹果”成为了揭示机器视觉内在认知缺陷的隐喻性靶点,在一种极致的对立中带来病态、异样且诡谲的瑰丽:一种将观看经验引向不适、错位与认知崩解的方式。苹果在西方创世神话中被标记为“禁果”(forbidden fruit),象征原罪、诱惑与知识的代价,也昭示着人类在欲望驱动下的必然沉沦;从古典绘画到当代艺术,苹果始终作为美与恶的混合载体频繁出现。在帕格伦的艺术语境中,苹果进一步蜕变为数据与机器认知中的病灶。帕格伦以渐变、渗透、侵蚀的视觉叙事手法,将光怪陆离的意象渗透进影像集的内在肌理,借此,一种潜入感知系统、缓慢扩散、逐步腐蚀的视觉隐喻结构得以显形。这不仅直观呈现了欲望、偏见与集体无意识如何隐秘地塑造AI训练集的视觉逻辑,也是对AI训练集所依赖的视觉正确性与分类逻辑的质疑——训练集影像所承载的“数据美学”是否早已被暗中渗透?

事实上,ImageNet的分类逻辑从未是纯粹的技术过程,而是深嵌于政治偏见与文化预设的复杂机制。训练集中影像的选择、识别与标注均建立在未经充分验证且高度偏倚的认知前提下,而这种特定世界观不可避免地主宰着AI模型的再生产过程。帕格伦的《从“苹果”到“异常”》有力地批判了所谓的“技术无垢”的神话:它揭示了影像在被转化为“数据”之时,必然伴随着无法回避的“畸变”与“偏见化”。通过将本应隐匿于深层网络的训练影像移入展览空间,帕格伦使AI系统的“盲视”(blindsight)逻辑获得了感知性和可见性。原本去语境化的数据影像被还原为一种能够被“玩味”的政治性图景,算法流程中被神秘化、技术化的部分再次暴露出争议性的面貌。与此同时,训练集中的影像也绝非中性的数码碎片,原生的边缘性和异质化反而成为提供“多样性”的数据养料,推动促成由特定的社会、文化与权力语境联合构成的视觉秩序。总之,这一秩序的建构不仅根植于影像数据的选择与分类,更暴露了AI视觉系统赖以成立的知识结构中潜藏的认识论与形而上学的不稳定性。这些被遮蔽的预设规定了哪些影像值得观看,哪些被忽略,哪些必须被命名、分类与治理。在这场算法驱动的观看和筛选制度中,世界的再现被深刻地政治化了。

正如哈尔·福斯特(Hal Foster)对帕格伦影像集《未见之地》(Trevor Paglen:Sites Unseen,2018)的书评[11]所指出的,当下对影像数字化与“标签滑移”(label slippage)的讨论忽视了一个更本质的转向——即影像的“机器可读性”(machine readability)与“影像不可见性”(image invisibility)之间的结构张力。影像的伦理问题已经不在于其内容本身,而在于影像在算法逻辑下如何被结构化与格式化。在识别维度上,AI训练集中的偏见分类机制强化了某种“感染性”路径,揭露了隐藏的政治介入与价值判断。数以万计的影像被划分入预定类别,而这些分类标准本身却带有强烈的文化偏向与系统性的忽视。例如,某些图像因文化认同而被反复标注,而“异质”图像则逐渐被边缘化,这使偏见成为AI系统中根深蒂固的“隐性参数”(hidden parameters)。而在生成维度上,图像的生成机制已从单纯的“再现性”转向具有症候意义的“生殖性”。当下由提示词(prompts)驱动的生成系统(如Sora、DALL·E、Midjourney、Refworks)与语言模型(如ChatGPT、DeepSeek)的协同运作,产生出海量具备幻觉(hallucination)特质的图像内容。这些AI生成图像拥有病毒般的生命特征:生成迅速、传播高效、转瞬即逝,更接近一种“感染性媒介”(infectious medium)。在这种症候性机制中,AI生成的图像不是对现实的简单再现,而是对集体认知盲点、无意识欲望和偏见的症候性放大——仿佛病毒自表层入侵,直抵感知结构的神经中枢。

20世纪末,计算机病毒已预示媒介感染的潜在威胁。尽管传统病毒的影响似乎淡出视野,但媒介自身的“易感性”(susceptibility)并未消失。在当代语境中,“感染”(infection)已超越生物病理的含义,不再单纯指涉技术的错误复制,而更关乎文本与符号系统在意义上的腐蚀、侵蚀及异变。特别是在算法控制的“数治时代”,媒介的感染性呈现出更显著的精神病性倾向(psychopathic tendency)。齐林斯基(Siegfried Zielinski)曾指出,这种“精神病媒介”(psychopathia medialis)的谱系可追溯至18世纪末弗朗茨·安东·梅斯梅尔(Franz Anton Mesmer)主导的电子治疗实验,而整个20世纪的电子技术主导的文化环境中,都是这一病理机制的持续延展。[12]如今,算法机器与生成式装置进一步强化了这一病理机制,赋予其更强大的传播力和话语权,形成了一种全新的“感染”范式。

当我们打开Sora、Refworks、Midjourney等生成平台的欢迎界面,AI影像即以一种主动且入侵性的方式占领我们的感知空间。这些作为技术竞品的AI影像,像是技术主动生成的幻觉性病灶,不断诱发视觉感知细胞的异常增殖与病理性聚集。与此同时,社交媒体平台所提供的即时生成与算法驱动的传播机制更构成了一种加剧视觉感染的循环路径:内容首先在小范围内被算法筛选并进行测试,若反馈积极,则迅速进入更大规模的“病毒式传播”阶段;其中隐含的病态信息更以癌变般的速度蔓延。在这一过程中,AI影像不仅以主动生成性(generative agency)与感知易感性嵌入视觉表征体系,而且通过持续的反射、嵌套和替换,逐步侵占、重塑并取代现实影像,形成症候性的病态幻象。由此,AI影像作为不洁媒介构成了一套受算法驱动的感染网络,揭示了影像在算法控制社会中所具备的多重功能:作为传染源(图像病灶)、技术中介(传播途径)和病理性意识形态的寄主装置(易感对象)。

3 幻觉失乐园:模型的幻觉机制与“舒适的恐怖谷”

正如列夫·马诺维奇(Lev Manovich)与埃马努埃莱·阿里埃利(Emanuele Arielli)合著的《人工美学:生成式 AI、艺术和视觉媒体》(Artificial Aesthetics:Generative AI,Art and Visual Media,2024)所指出的:生成式AI通过学习数据,可近乎完美地再现伦勃朗(Rembrandt)经典的明暗对照法(chiaroscuro)——它通过观察346幅作品的“类型细微变化”,并提取相应的“特征与模式”以进行视觉复制。[13]然而,这种“计算矫饰主义”(computational mannerism)虽然能够有效复制形式风格,却难以模拟杜尚(Marcel Duchamp)式的观念艺术,例如《下楼的裸女二号》(Nu descendant un escalier n° 2,1912)、《泉》(Fountain,1917)、《L.H.O.O.Q.》(1919)等经典作品,因为“杜尚的作品存量太少。”[13]事实上,这一差异根源于形式再现与观念抽象之间的鸿沟:前者依赖可量化、可压缩的视觉经验模式;而后者则需要超越既定视觉范式的批判性创造能力。值得注意的是,《人工美学》成书时期(2021—2024),正处于生成式AI从理论话题跃升为颠覆性实践的转折点。这一转折适逢“新冠疫情”肆虐全球背景下的“隔离”困境,原本属于人类认知活动的思想与欲望,以及构造这些思想的“认知机器”,从主观意识领域和现实人际交往迅速迁移到算法主导的技术框架之中。早期理论界对于“无主体创作”(effortless creation)作者权归属的伦理困境探讨,曾占据AI影像生成领域的核心话题,实际上,这些讨论还未触及一个更根本的危机:人类正将长期以来影像生产所拥有的形而上学特权——即捕捉光影与瞬间意义的能力——逐步让渡给一个不透明且不可知的算法黑箱。我们既无法知晓AI如何获得和处理意义,也难以追踪算法如何重构和改写影像与语言的内在逻辑。在这个拒绝透明、隔绝光源的回路中,AI建构了一座静默、高效且充满诱惑的幻觉失乐园(paradise lost)。

在幻觉失乐园中,生成式AI复刻了“傀儡神话”的当代版本:文本指令一经输入,便可催生具有“生命幻觉”的拟像(simulacrum)。然而,这一看似魔术般的生成逻辑,实则建立在对海量数据的任意挪用基础之上,包括版权存疑的匿名影像、错误素材以及多轮算法加工后的合成片段。在此背景下,AI模型的“过拟合”(overfitting)问题成为诱发AI幻觉(AI hallucination)的关键机制。“过拟合”指的是模型对训练数据中的噪声或异常值进行过度学习,进而在处理新输入时将这些被错误认定的模式误用,从而生成表面合理但实质虚构的内容。在大语言模型中,这表现为对语料缺陷的系统性放大——模型记忆的偏误越多,在无关情境中制造似真幻觉的倾向便越强。[14]更深层次的挑战在于,这些幻觉并非随机误差,而是生成式算法在试图泛化与压缩数据模式时产生的固有缺陷。这类算法幻觉由高度组织化的伪逻辑拼贴而成,并借助“过度自信输出”(overconfident generation)的修辞策略,以增强其似真性。生成式AI通过将问题数据碎片编织为看似自洽的内在逻辑,构建出一幅充满幻觉且自我循环的“拟真现实”(simulated reality)。

图5 Sora生成的一个女性躺在浴缸中的影像,展示了

AI在生成逼真视觉效果方面的能力,同时也揭示了文化符号的拼贴和视觉惯例的复刻

Fig.5 Image generated by Sora depicting a woman in a bathtub,showcasing AI’s capability in creating realistic visuals while revealing the collage of cultural symbols and replication of visual conventions

视觉模型同样暴露出类似于语言模型的内在逻辑。当训练数据的质量与洁净度不足以支撑系统运作时,生成式AI必然倾向于输出一种“拟真却似幻”的幻觉影像。这一现象在文本生成视频模型Sora中表现得尤为明显。以笔者一次具体的生成实验为例。当我们尝试生成一段仅5秒的视频,提示词为:“她睡在装满一池莲花的浴缸内,神情复杂。”Sora反馈的结果是一个拥有商业画报模特般精致面容的女性,她躺在西方现代家具空间中几乎千篇一律的白色浴缸内,表达的复杂神情微妙而逼真(图5)。由数据集萃取而来的影像却拥有几乎与真实世界绝无二致的胶片级光感(film-like luminosity),画面柔润细腻,颗粒感分明,脱离了AI早期过于光滑与“油腻”的初级美学倾向,看似完成了一种视觉美学上的跃迁。然而,提示词一旦脱离主流数据库所涵盖的典型视觉模式,生成系统的幻觉性和不稳定性便逐渐显露。例如另一次生成实验:输入提示词“1.8米床的法式风格卧室全景,带半透明帷幔、白纱帘、地毯,阳台落地窗、绿植花卉,像侯麦的电影。”(图6)生成的结果与宜家(IKEA)样板间、Instagram家居博主、现代商业广告等数十年来累积的“明亮卧室”影像想象高度重合。笔者将这种过于规整而反复出现的“类完美影像”所带来的不安,命名为新的“舒适的恐怖谷”(comfortable uncanny valley)现象:一种视觉上疑似完美、无瑕的合成陷阱,但它的高度拟真和同质性,反而令人莫名焦虑,可人们却难以直指不适感的来源。

图6 Sora生成的法式风格卧室影像,体现了AI对商业化视觉范式的依赖和同质性,呈现出一种“舒适的恐怖谷”效应

Fig.6 Image of a French-style bedroom generated by Sora, reflecting AI’s reliance on commercial visual paradigms and homogeneity,presenting a “comfortable uncanny valley” effect

当提示词被进一步推入包含高度文化异质性和复杂美学指向的场景描述中,算法的幻觉裂缝进一步暴露:

故事板1:殖民地风格的法越融合卧室,以乳白色为主色调,阳光透过铺着亚麻布的落地窗照射进来,头顶上有一个缓慢旋转的吊扇,墙面饰有法式线条与莲花意象,氛围中弥漫着俳句般的清冷感。

故事板2:法式阳台上有着风车茉莉、玫瑰、天竺葵,铸铁栏杆上缠绕着龟背竹藤,竹制边桌上,放着泛黄的书页和青瓷茶具,热带季风吹拂着薄纱窗帘,室内混合着柠檬叶、香茅与九重葛的复杂香味。

故事板3:一张亚麻软垫高脚木质床,配有三层渐变的薄纱天篷,点缀有手工刺绣,床脚铺着靛蓝的蜡染毯。

故事板4:午后的太阳光斑,在柚木拼花地板上层层堆叠,一扇漆屏风将阳光折射成碎钻光斑。

在这类细密反复,有意避开西方主流商业图像特征的提示指令下,AI生成的影像逐步表现出明显的逻辑幻觉:场景似乎仍然处于某页“商业画报”中,但阳光方向出现异常扭曲,龟背竹荒谬地拼贴在台灯底座,植物呈现出塑料般的朦胧质感,床头粉色莲花显得刻意而异质。这些场景作为算法过拟合的副产物,不再是颗粒感的复现,也不同于商业影像的1:1投射,而更像是某种梦境残片在黑箱中的杂合拼贴——那么,这是梦的拟像,还是幻觉带来的副作用呢?(图7)Sora 的界面像一座幻觉的游乐场,多个拼贴窗口轮番上演不同的“幻觉剧目”。而这些看似丰富多元的“游乐场景”,其实只是训练数据分布的映射区间,是数据残渣的“梦境碎片”,既非来自于人类自觉的视觉经验,也并未获得人类式的内在理解。

图7 Sora根据复杂提示词生成的卧室场景影像,展示了AI在处理文化异质性和美学复杂度时的幻觉效应

Fig.7 Image of a bedroom scene generated by Sora based on complex prompts,demonstrating AI’s hallucinations in handling cultural heterogeneity and aesthetic complexity

当我们回溯这些高度精致化的生成影像时,可能会疑惑不解:它们所囊括的是非人智能的机器幻觉,还是平行世界里人类自身幻觉呢?这些影像是否仅仅是人类潜意识中刻板、重复、媚俗与欲望结构的移映与投射?那些面容完美的模特、光线下细腻的皮肤与发丝、色泽鲜美的菜肴,粗暴地再现了数百年来人类视觉史中关于“精致”“完美”和“消费主义”的规范想象。与其说此类视觉输出一种创造,不妨说这是一种历史上种种主流拟像的视觉霸凌。在“拱廊研究计划”(“Das Passagen-Werk”)中,本雅明借助“拱廊街”意象揭示了现代性所内含的空间幻觉结构——“市场幻境”(illusion des marktes)与“居室幻境”(illusion des zimmers)交织成一场资本主义感知的迷游体验。[15]如今,AI生成的精致影像似乎也是由“市场幻境”和“居室幻境”交相辉映而成的复合体。它们并未开辟一个“平行世界”,而是以晶体般扭曲的方式,再次折射出人类潜意识里反复回响的欲望模型、性别符码与文化偏见。算法所“赋能”的视觉舒适,本质上仅是统计学美学(statistical aesthetics)反复打磨的数据均值。

正如“浴缸莲花”视频所带来的深层不适感:来自东方的莲花意象,被刻意置于西方现代主义卫浴空间中。似真却刻意的精致造成视觉上的“完美瑕疵”,暴露了训练数据的结构性偏倚——它们本质上正是AI的生成体系被商业影像库(如Getty Images或IMDb)所完全浸染的表现。如今,由海量数据驱动的生成式AI彻底改变了在线文本与影像生态,“成为社会新权力掮客”[16],共同建构出一种悖谬的视觉现实:算法机制在自我封闭、自我反刍中,将世界转译为“机器可读”(machine-readable)却“人类不可解”的像素编码。这些影像以精致、圆融且过度拟真的假面涌入社交媒体平台、艺术作品与商业广告之中,与人类创作的原生影像彼此杂糅,共同组成未来模型训练的底本。这一自我回路式(self-loop)的训练模式(即不断地调用与反复强化生成影像本身),最终必然导向一种类似于“自体免疫疾病”的技术症候。

4 结语

亚历山大·斯特雷克(Alexander Strecker)指出,在AI影像时代,职业摄影师与业余创作者正被一种集体性焦虑包围,“这常以末世隐喻描绘:洪水、浪潮、深海与影像激流,一切似乎将我们卷走。”[10]AI影像所展现出的瑰丽、精致而病态的美学,内嵌了扭曲人类经验与窃取思想能力的不可持续性,并同时以此潜在性地重塑人类的感知边界。生成式AI出现之前的世界,似乎已成为无法回返的“乌有之乡”;而对AI逻辑的抗拒亦显得徒劳,未被渗透的“净土”在可预见的将来也难以寻觅。影像最令人不安的症结,一方面在其缘由,即数据集原有的偏见预设和“异常”谱系;另一方面则是结果,这种看似“无菌”、实则隐秘污染的数据逻辑。它们以美学表象为诱饵,最终将我们引入一个由幻觉主导的共生病症——我们不仅活在自身幻觉移印的影像中,更逐渐以影像数据集的偏见逻辑描摹自身的思考。这种迫使我们重新思考AI时代的影像、数据与权力之间的深层结构关系,以及主体在这种影像政治体系中所可能获得的微弱抵抗点。

利益冲突: 作者声明没有利益冲突。

附录

① 约翰·麦卡锡、马文·闵斯基(M.L.Minsky)、纳撒尼尔·罗切斯特(N.Rochester)、克劳德·香农(C.E.Shannon)共同发起了“达特茅斯夏季人工智能研究计划”(Dartmouth Summer Research Project on Artificial Intelligence),简称“达特茅斯会议”,该会议提案标志着人工智能作为正式领域的诞生,提案继续讨论了计算机、自然语言处理、神经网络(neural network)、创造力(creativity)等重要领域,时至今日,提案涉及的领域仍然与人工智能主攻方向密切相关。Cf.McCarthy J,Minsky M L,Rochester N,Shannon C E.A Proposal for the Dartmouth Summer Research Project on Artificial Intelligence.August 31,1955[J].AI Magazine,2006,27(4):12-14.https://doi.org/10.1609/aimag.v27i4.1904

② 图灵讨论了机器是否能思考的可能性,奠定了AI的基础。Cf.Turing A M.Computing machinery and intelligence[J].Mind,1950,59(236):433-460.https://doi.org/10.1093/mind/LIX.236.433

此外,“能思考的机器”领域还有控制论(cybernetics)、自动机理论(automata theory)、复杂信息处理(complex information processing)等别称。具体可参考帕梅拉·麦科德克(Pamela McCorduck)所著的《能思考的机器》(Machines Who Think,2004)一书。

③ 词语“golem”在《诗篇》139:16中出现一次,在希伯来文中意为“未成形的物质”。亚当在获得灵魂前的最初12小时被称作golem。《创世书》(Sefer Yetzirah)讨论了通过字母和数字组合创造宇宙的观念,这为后来傀儡的创造提供了理论基础。最早的关于如何创造傀儡的书面记录出现在12世纪末至13世纪初,由埃利亚泽·本·耶胡达·沃姆斯(Eleazar ben Jehuda of Worms)提及——他描述了通过使用希伯来字母和上帝的名字(shem)来激活傀儡的仪式,这通常涉及将纸条插入嘴里或额头上。

④ 非空WordNet 同义词集总数:21,841;图片总数:14,197,122;带有边界框注释的影像数量:1,034,908;具有SIFT特征的同义词集数量:1,000;具有 SIFT 特征的影像数量:120万张。Cf.ImageNet statistics[EB/OL].2020-09-07[2025-04-19].Available from:http://image-net.org/about-stats

[31] 通讯作者 Corresponding author:周厚翼,ycxhxxzhy@163.com

收稿日期:2025-04-21; 录用日期:2025-06-07; 发表日期:2025-06-28

基金项目:本项研究得到了2024年度国家社会科学基金艺术学项目“数智时代AI赋能影视艺术创新研究”(资助号24BC066)的资助。

参考文献(References)

[1] Mayor A. Gods and Robots: Myths, Machines, and Ancient Dreams of Technology[M]. Princeton: Princeton University Press, 2018.

[2] Kowalski R. Algorithm=logic+control[J]. Communications of the ACM, 1979, 22(7): 424-436.

https://doi.org/10.1145/359131.359136

[3] Von Neumann J. Theory of Self-Reproducing Automata[M]. Ed. by Arthur W. Burks. Urbana: University of Illinois Press, 1966.

[4] Deleuze G. Cinéma 1, L’Image-mouvement[M]. Paris: Les Éditions de Minuit, 1983.

[5] Benjamin W. Kleine Geschichte der Photographie[A]. In Tiedemann R, Schweppenhäuser H(eds). Gesammelte Schriften[M]. Band II·1. Fankfurt am Main: Suhrkamp, 1977: 371.

[6] Roser M. The brief history of artificial intelligence[EB/OL]. OurWorldinData. org, 2022[2025-04-19].

https://ourworldindata.org/brief-history-of-ai

[7] Hurt A. Robots and Artificial Intelligence Have Ancient Mythology Origins[EB/OL]. Discover Magazine, 2022-09- 10 [2025-04-19].

https://www.discovermagazine.com/technology/robots-and-artificial-intelligence-have-ancientmythology-origins

[8] Deleuze G. Différence et Répétition[M]. Paris: Presses Universitaires de France, 1968: 169-217.

[9] Deng J, Dong W, Socher R, Li L-J, LI K, Fei-Fei L. ImageNet: A Large-Scale Hierarchical Image Database[C]. In: 2009 IEEE Conference on Computer Vision and Pattern Recognition. Miami, FL: IEEE, 2009: 248-255.

[10] Strecker A. The Interpretation of Images: Retaining Our Humanity in the Age of Artificial Intelligence[EB/OL]. LensCulture, 2018-07-17 [2025-04-19] .

https://www.lensculture.com/articles/trevor-paglen-the-interpretation-of-images-retaining-our-humanity-in-the-age-of-artificial-intelligence

[11] Foster H. You have a new memory[L]. London Review of Books, 2018, 40(19).

https://www.lrb.co.uk/thepaper/v40/n19/hal-foster/you-have-a-new-memory

[12] 齐林斯基. 媒介之后: 来自逐渐退潮的20世纪的消息[M]张艳, 等译. 上海: 同济大学出版社, 2023: 116-117.

[13] Manovich L, Arielli E. Artificial Aesthetics: Generative AI, Art and Visual Media[M]. 2024: 10-11.

[14] Sun Y et al. AI hallucination: towards a comprehensive classification of distorted information in artificial intelligence- generated content[J]. Humanit Soc Sci Commun, 2024, 11: 1278.

https://doi.org/10.1057/s41599-024-03811-x

[15] Benjamin W. Walter Benjamin Gesammelte Schriften V[M]. Ed. Rolf Tiedemann. Frankfurt am Main: Suhrkamp Verlag, 1983: 60-77.

[16] Daikopoulos N. Algorithmic accountability reporting: on the investigation of black boxes[A]. Tow Center for Digital Journalism, Columbia Journalism School, 2018 [2025-04-19].

http://towcenter.org/algorithmic-accountability-2/

Public Health Anxiety in the Age of AI-generated Image: Infectious Media and the Hallucinated Paradise Los

(Department of Chinese Language and Literature, Fudan University, Shanghai 200433, China)

Abstract: The rapid development of modern artificial intelligence (AI) has transformed the allegorical myth of “artificial life” into tangible technological reality, giving rise to a new visual ecology and media environment. However, the very mechanisms of image generation have also infected the neural circuitry of AI-generated images. This infection manifests as a kind of media pathology caused by the biases, fragments, and ideological residues embedded in training dataset, which further generates an unprecedented public health anxiety. By analyzing the ImageNet training set, the artwork of Trevor Paglen, and image generation experiments with Sora, it becomes apparent that the “synthetic data” self-generated within algorithms carries inherent structural flaws, which drive the models into a state of overfitted hallucinatory reproduction. We thus seem to be caught up in a comfortable valley of terror created by the “hullucinated paradise lost”. In such a scenario, resistance to AI logic appears increasingly futile, and any “pure zone” untainted by algorithmic contamination will likely be difficult to find in the foreseeable future.

Keywords: Artificial Intelligence(AI), AI-generated image, AI hallucination, trevor paglen, synthetic data

Citation: ZHOU Houyi. Public Health Anxiety in the Age of AI-generated image: infectious media and the hallucinated paradise lost[J]. Advances in Art Science, 2025, 2(2): 186-197.