基于G-GhostNets轻量化网络的高光谱图像分类

(中国海洋大学信息科学与工程学部, 青岛 266100)

摘要: 高光谱图像分类在遥感图像研究中具有广泛用途, 然而在嵌入式设备中应用深度学习模型执行高光谱图像分类任务时, 会面临参数量大和计算速度慢的问题, 本文主要针对GPU设备, 提出了使用轻量化网络G-GhostNets, 该网络同时考虑了图像的光谱特征和空间特征, 并且采用聚合中间特征的G-Ghost Stage使模型在GPU上运行, 保持高精度的同时能够进行高效计算。为验证其性能, 本研究将ResNet50和C-GhostNets作为对比网络, 分别对经过预处理的Pavia University 、Indian Pines以及Salinas数据集进行分类实验。实验结果表明, G-GhostNets在高光谱图像分类任务上具有优异的性能, 在保证高精度的同时能够在GPU上高效运行, 能够在较短的时间内实现对每一类的高精度推理。

关键词: 高光谱图像分类, 特征提取, 深度学习, 轻量化网络

引用格式: 常佩佩. 基于G-GhostNets轻量化网络的高光谱图像分类[J]. 交叉科学学报, 2025, 2(1): 48-57.

文章类型: 研究性论文

收稿日期: 2025-03-14

接收日期: 2025-03-19

出版日期: 2025-03-28

1 引言

高光谱成像作为遥感技术的一个关键领域,能够记录从可见光到近红外波段的电磁辐射信号。相关成像装置通常为同一地表区域产生数百个精细的光谱带。在高光谱图像中,每一像素点可被解读为多维数据结构,其各部分反映不同波长处的光谱反射性质[1]。高光谱图像分类是指通过分析每个像素的光谱特性将其分配到某一特定类别[2],广泛应用于地质勘探、精准农业、生态环境监测以及科学遥感等领域[3]。

高光谱图像分类研究初期,主要关注其光谱特征,开发了多种像素级分类技术,如支持向量机[4],多项式逻辑回归[5]等。与此同时,部分方法通过引入特征提取和降维策略来提升分类效率,如主成分分析[6],线性判别分析[7]等。近年来,研究指出空间特征对高光谱图像分类精度的提升作用显著[8],促使光谱-空间特征分类框架逐渐兴起,这些方法通过整合空间领域信息优化分类结果。

近些年,深度学习在海量数据分析中的出色表现促进了卷积神经网络在高光谱图像分类领域的广泛使用,并获得了显著成效[9]。Lv等人提出了一种高效的空间-光谱交互网络,通过引入内卷积算子以聚焦于感受野内的空间特性,同时设计双池化层以融合空间和光谱特征,促进两者间的深度交互[10]。Yao等人提出了一种迭代半监督CNN框架,先训练一个CNN模型生成伪标签,再利用主动学习策略从超像素片段中筛选出标签一致且信息丰富的样本,对这些样本及其标签和伪标签进行迭代优化训练[11]。除此之外,还有生成对抗网络[12]、图神经网络[13]、残差网络等也被用于高光谱图像分类任务[14]。然而,现有深度模型因参数量大和计算需求高,尤其在处理高光谱图像数据时,推理效率低下,阻碍了其在资源匮乏场景下的运用。

高效的神经网络架构设计可以用更少的参数量和计算量建立性能较好的深度学习网络,如MobileNet[15],ShuffleNet[16]等。尽管这些模型在很少的计算量下获得了较好的性能,但特征图之间的相关性和冗余性利用不充分。研究者引入了在CPU上能高效使用的C-Ghost模块,建立轻量化网络C-GhostNets[17],以更加经济高效的方式来利用冗余的特征图。但是由于CPU和GPU的硬件架构存在显著差异,C-Ghost模块未能有效发挥GPU的并行计算潜力。目前,针对GPU的高光谱图像分类任务的深度模型研究相对匮乏。

本研究提出了使用轻量化网络G-GhostNets,该网络兼顾了图像的光谱特性和空间特性,并且采用聚合中间特征的G-Ghost Stage使模型在GPU上运行。为验证其性能,本研究构建了G-GhostNets以及ResNet50和C-GhostNets三个深度学习网络,分别对经过预处理的Pavia University、Indian Pines以及Salinas数据集进行分类实验。最后,通过分析分类结果的准确率、Kappa系数等性能指标以及模型的计算效率,全面评估了G-GhostNets的优越性。

2 数据与处理

为了评估所提出的模型的优越性,实验中使用了三个常用的真实世界数据集,分别是Pavia University数据集,Indian Pines数据集以及Salinas数据集。所有关于真实情况的详细信息列于表1、表2、表3以及图1、图2、图3中。

Pavia University数据集由德国ROSIS-03机载反射光学光谱成像仪于2003年在意大利帕维亚城市部分区域采集而成,属于高光谱数据。该成像仪可连续捕捉波长在0.43~0.86μm范围内的115个光谱波段,生成的空间分辨率为1.3m。由于噪声干扰,移除了其中12个波段,因此实际使用103个波段构建图像。该数据集的尺寸为610×340,总像素数达2207400,其中地物像素仅占42776个,涵盖9种地物类别[18]。

Indian Pines数据集由AVIRIS传感器获取,拍摄地点位于美国印第安纳州西北部的Indian Pines地区。该传感器可在0.4~2.5μm范围内连续成像,共有224个波段,去除吸水区域后可用波段为200个。数据集包含145×145的高光谱图像,总像素21025个,其中地物像素10249个,涵盖16种地物类型,空间分辨率约20m。拍摄时间为6月,场景以农业为主,部分区域为天然植被,部分农作物仍处于早期生长期,覆盖率不足5%[19]。

Salinas数据集由AVIRIS成像光谱仪进行拍摄,记录了美国加利福尼亚州Salinas山谷的影像。其空间分辨率为3.7m,原始波段总数为224个,实际可用波段为204个。该数据集的尺寸为512×217,适用于分类的像素数量为54129个,涵盖16种类别[20]。

在进行深度学习的训练时,需要合适的输入和标签数据,因此,我们需要对数据集进行预处理。如果将单个像素点视为一个样本会导致丢失大量的空间信息,从而影响分类的精度。因此我们采用空间取块方法,将每个像素点的7×7邻域中所有像素作为一个样本,补充空间上下文信息。当像素点位于图像边缘时,其邻域会超出图像的原始尺寸,对超出的部分使用零填充,使用中心点的标签作为该样本的真实标签。与此同时,在高光谱图像内,各通道的光谱特性尺度往往存在差异,这会导致样本特征之间差异较大,从而影响分类效果。如在Pavia University数据集中,通道72和73的光谱范围远大于其他通道。因此,高光谱图像需经过归一化处理,将不同通道的尺度统一到合适的范围内。综上所述,我们对训练数据进行了空间取块和归一化操作。

表1 Pavia University数据集中土地覆盖类别及样本数量

Table 1 Land cover classes and sample numbers in the Pavia University dataset

|

类别序号 |

土地覆盖类别 |

总样本数量 |

|

C1 |

柏油 |

6631 |

|

C2 |

草地 |

18649 |

|

C3 |

砾石 |

2099 |

|

C4 |

树木 |

3064 |

|

C5 |

油漆金属板 |

1345 |

|

C6 |

裸露的土壤 |

5029 |

|

C7 |

沥青 |

1330 |

|

C8 |

砖块 |

3682 |

|

C9 |

阴影 |

947 |

图1 Pavia University数据集的地面实景图

Fig.1 Ground truth map of the Pavia University dataset

表2 Indian Pines数据集中土地覆盖类别及样本数量

Table 2 Land cover classes and sample numbers in the Indian Pines dataset

|

类别序号 |

土地覆盖类别 |

总样本数量 |

|

C1 |

苜蓿 |

46 |

|

C2 |

免耕玉米田 |

1428 |

|

C3 |

少耕玉米田 |

830 |

|

C4 |

常规耕作玉米田 |

237 |

|

C5 |

牧草地 |

483 |

|

C6 |

草地与树木混合区 |

730 |

|

C7 |

已割牧草地 |

28 |

|

C8 |

成行干草堆 |

478 |

|

C9 |

燕麦田 |

20 |

|

C10 |

免耕大豆田 |

972 |

|

C11 |

少耕大豆田 |

2455 |

|

C12 |

净作大豆田(无杂草) |

593 |

|

C13 |

小麦田 |

205 |

|

C14 |

林地 |

1265 |

|

C15 |

建筑-草地-树木-车道混合区 |

386 |

|

C16 |

石质/钢制塔状结构 |

93 |

图2 Indian Pines数据集的地面实景图

Fig.2 Ground truth map of the Indian Pines dataset

表3 Salinas数据集中土地覆盖类别及样本数量

Table 3 Land cover classes and sample numbers in the Salinas dataset

|

类别 |

土地覆盖类别 |

总样本数量 |

|

C1 |

绿色椰菜种子1 |

2009 |

|

C2 |

绿色椰菜种子2 |

3726 |

|

C3 |

休耕地 |

1976 |

|

C4 |

粗糙-休耕地 |

1394 |

|

C5 |

光滑-休耕地 |

2678 |

|

C6 |

残株 |

3959 |

|

C7 |

芹菜 |

3579 |

|

C8 |

自然生长葡萄 |

11271 |

|

C9 |

葡萄园-待使用 |

6203 |

|

C10 |

老化玉米种子 |

3278 |

|

C11 |

长叶莴苣-4周 |

1068 |

|

C12 |

长叶莴苣-5周 |

1927 |

|

C13 |

长叶莴苣-6周 |

916 |

|

C14 |

长叶莴苣-7周 |

1070 |

|

C15 |

未整形葡萄园 |

7268 |

|

C16 |

葡萄园棚架 |

1807 |

图3 Salinas 数据集的地面实景图

Fig.3 Ground truth map of the Salinas dataset

3 研究方法

3.1 实验设置

实验运用 Python 语言,并依托深度学习框架 PyTorch 1.10.1 开展模型开发与训练。硬件环境为 Windows 11操作系统,配备Intel(R)Core(TM)i7-8750H处理器、NVIDIA GeForce GTX 1060显卡以及8 GB内存。通过CUDA 10.2和CUDNN 8.4实现加速计算。在模型训练阶段,采用交叉熵损失函数作为分类任务的损失衡量标准。该函数通过对比模型预测值与数据的实际标签,衡量模型的预测准确性,随着预测精度的提升,损失值逐渐减小。采用Adam优化器,该优化器相较于传统的随机梯度下降具有更快的收敛速度和更高的效率,能够更有效地逼近损失函数的最优解。训练过程中,调整了若干关键超参数以优化模型性能,包括迭代次数、批处理大小以及学习率。其中,迭代次数表示模型对整个训练数据集进行完整训练的轮数,批处理大小指定了每次迭代中用于调整模型参数的样本数量,而学习率则决定了参数更新幅度的大小。经过实验,最终确定迭代次数为 50 轮,批处理大小为 16,学习率采用初始值为0.001,并设置每 5 轮迭代减半的动态调整策略。

3.2 G-GhostNets网络介绍

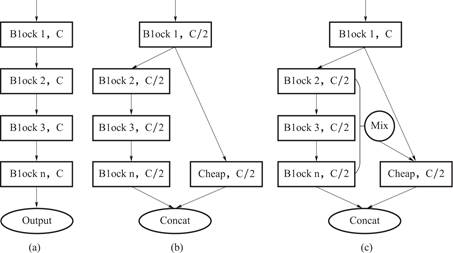

3.2.1 G-Ghost Stage

一般而言,卷积网络(CNN)中常用的骨干模型一般是由几个Stage顺序连接,这些处理 Stage的特征的分辨率逐渐降低(图4(a))。对于网络中的每个Stage,里面有n个Block,分别是{L1,…,Ln},若给定输入特征图X,第一个Block和最后一个Block的输出分别是由公式(1)和公式(2)表示。

Y1=L1(X)(1)

Yn=Ln(Ln-1(…(L2(Y1))))(2)

为了充分利用好Block之间特征的冗余,将最后一个Block的特征分为复杂特征![]() 和廉价特征

和廉价特征![]() 。复杂特征仍然需要一系列顺序的Block生成,由公式(3)表示,L'1,…,L'n分别是公式(2)中的对应层,但是通道数不同,若λ表示廉价特征的比例,则通道数只有原来通道数的(1-λ)倍。

。复杂特征仍然需要一系列顺序的Block生成,由公式(3)表示,L'1,…,L'n分别是公式(2)中的对应层,但是通道数不同,若λ表示廉价特征的比例,则通道数只有原来通道数的(1-λ)倍。

![]() =L'n(L'n-1(…(L'2(Y1))))(3)

=L'n(L'n-1(…(L'2(Y1))))(3)

廉价特征可以直接从浅层特征中经过一些简单的变换获得,如公式(4)所示。

![]() =C(Y1)(4)

=C(Y1)(4)

最后把复杂特征和廉价特征连接在一起得到这个Stage的最终输出得到G-Ghost Stage(图4(b)),如式(5)所示。

Yn=[![]() ,

,![]() ](5)

](5)

3.2.2 聚合中间特征的 G-Ghost Stage

在一个Stage内,尽管深层特征可通过廉价操作直接生成,但可能缺少需通过多层提取的深层信息。为填补这一信息缺失,借助复杂路径中的中间特征来提升廉价操作的表达能力,把中间特征收集起来转换到与廉价特征相同的域中再混合(图4(c))。

图4 (a)为 CNN Stage,(b)为 G-Ghost Stage,(c)为聚合中间特征后的G-Ghost Stage

Fig.4 (a)CNN Stage,(b)G-Ghost Stage,(c)G-Ghost Stage with Aggregated Intermediate Features

3.2.3 适用于高光谱图像分类的G-GhostNets

如表4所示,为了使G-GhostNets适用于高光谱图像分类任务,我们对该网络进行了重新设计。修改后的G-GhostNets模块主要由几个G-Ghost Stage组成,每个G-Ghost Stage包含3个Block。该网络首先利用3×3卷积产生32个通道,然后经过4个聚合中间特征的G-Ghost Stage,最后将通道数增加至368。最后,依次经过全局平均池化和1×1卷积层,将特征图转换为368维特征向量,并进行全连接操作,最终得到n个特征图,对应于3个数据集的多种类别,概率最大的那个特征图就是这个样本的预测类别。

表4 适用于高光谱图像分类的G-GhostNets模型

Table 4 G-GhostNets model for hyperspectral image classification

|

阶段 |

输出大小 |

操作 |

输出通道数 |

|

0 |

7×7 |

Conv3×3 |

32 |

|

1 |

7×7 |

Block |

24 |

|

|

|

Block×1 Cheap |

24 |

|

|

|

Concat |

24 |

|

2 |

7×7 |

Block |

56 |

|

|

|

Block×1 Cheap |

56 |

|

|

|

Concat |

56 |

|

3 |

7×7 |

Block |

152 |

|

|

|

Block×4 Cheap |

152 |

|

|

|

Concat |

152 |

|

4 |

7×7 |

Block |

368 |

|

|

|

Block×4 Cheap |

368 |

|

|

|

Concat |

368 |

|

5 |

1×1 |

Conv1×1 |

368 |

|

|

|

Pool&Conv1×1 |

368 |

|

|

|

Fully connected |

n |

3.3 评估指标

本实验使用准确率和Kappa系数来衡量分类性能。

准确率(OA)反映了正确分类的像素数量与图像总像素数量的比率。高光谱分类中,每个像素独立预测,准确率反映模型对整幅图像的全局分类能力。定义为

OA=![]() (6)

(6)

式中,C为类别数,N为总像素数,TPi表示第i类被正确分类的像素数。

Kappa系数可用于检测一致性,同时也能用来评价分类效能。在高光谱图像分类中,各类样本数量分布不均,而 Kappa 系数作为一种衡量指标,能够对模型的“偏向性”进行约束,对偏向性较高的模型赋予较低分数。定义为

Kappa=![]() (7)

(7)

式中,pe表示随机分类的期望一致性概率。

4 结果与讨论

4.1 分类性能分析

表5是ResNet50、C-GhostNets和G-GhostNets在三个数据集上的准确率和Kappa系数,实验结果表明,G-GhostNets在所有三个数据集上均取得了优异的分类性能。具体而言,相较于C-GhostNets,G-GhostNets在Pavia University、Indian Pines以及Salinas数据集上的准确率分别提升了0.58%、3.31% 和 0.48%,Kappa 系数分别提高了0.77%、3.75% 和 0.55%;与ResNet50相比,准确率分别提升了0.46%、4.11%和3.53%,Kappa系数分别提高了0.60%、4.71%和3.93%。这些结果表明,G-GhostNets在总体准确率和 Kappa 系数两项关键指标上均优于C-GhostNets和ResNet50,体现了其在高光谱图像分类任务中的显著优势。

G-GhostNets在总体准确率和Kappa系数上的优异表现充分展示了其在高光谱图像分类中的整体性能优势。总体准确率反映了模型在全局分类任务中的预测能力。相较于C-GhostNets和ResNet50,G-GhostNets在面对高光谱数据的复杂特性时,能够显著优化分类结果的可靠性。这种改进表明,G-GhostNets在处理高维数据时具备更强的鲁棒性,能够有效适应不同场景下的分类需求。同时,Kappa系数的提高进一步揭示了G-GhostNets在类别间区分上的均衡性优势。作为一项衡量分类一致性的指标,Kappa系数的提升意味着模型不仅在整体精度上有所突破,还在样本分布不均或数据特性多样的情况下保持了更高的分类公平性和稳定性。这种双重优势体现了G-GhostNets在设计上的科学性,为高光谱图像分类任务提供了一种高效且可靠的解决方案。

表5 ResNet50、C-GhostNets 和 G-GhostNets在三个数据集上的准确率和Kappa系数

Table 5 Accuracy and Kappa coefficient of ResNet50, C-GhostNets,and G-GhostNets on three datasets

|

数据集 |

网络模型 |

准确率(%) |

Kappa系数(%) |

|

Pavia University |

ResNet50 |

99.16 |

98.89 |

|

|

C-GhostNets |

99.04 |

98.72 |

|

|

G-GhostNets |

99.62 |

99.49 |

|

Indian Pines |

ResNet50 |

88.03 |

86.32 |

|

|

C-GhostNets |

88.83 |

87.28 |

|

|

G-GhostNets |

92.14 |

91.03 |

|

Salinas |

ResNet50 |

90.69 |

89.64 |

|

|

C-GhostNets |

93.74 |

93.02 |

|

|

G-GhostNets |

94.22 |

93.57 |

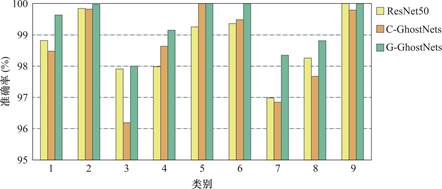

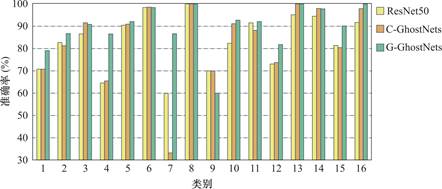

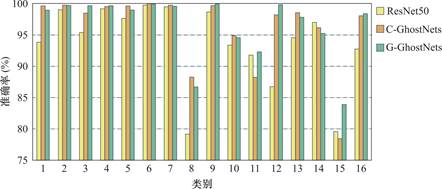

为了进一步探究三个网络在每一类分类准确性上的表现,我们对三个数据集的类别级性能进行了详细分析。图5,图6,图7展示了三个网络在Pavia University、Indian Pines和Salinas数据集上每一类的分类准确率分布。从图中柱状图的趋势可知,相较于其他两个网络,G-GhostNets在Pavia University数据集上的9类地物(共9类)获得了最高的准确率,在Indian Pines数据集上的13类地物(共16类)获得了最高的准确率,在Salinas数据集上的9类地物(共16类)获得了最高的准确率。这一观察结果与总体准确率和Kappa系数的提升趋势高度吻合。在Indian Pines数据上,G-GhostNets在燕麦田的分类结果比ResNet50和C-GhostNets低了10%,主要是由于燕麦田样本数量过少(20个)。在Salinas数据集中,两个多样本数量地物类别(自然生长葡萄和未整形葡萄园)在三个网络的分类结果均低于百分之九十,这一现象可能与训练样本的代表性不足或类别间光谱相似性较高有关,导致模型在这些类别上的区分能力受到限制。G-GhostNets在类别级准确率上的整体优越性得益于其G-Ghost Stage模块的设计。该模块通过特征分解与聚合策略,优化了光谱-空间信息的提取与融合,不仅提升了总体准确率,还在大多数类别上实现了更高的分类精度。相较于C-GhostNets的单一特征提取路径和ResNet50的深层堆叠架构,G-GhostNets的设计更能适应高光谱数据的复杂性,特别是在类别数量多、分布不均的场景中展现出更强的均衡性。

表6 ResNet50、C-GhostNets 和 G-GhostNets在三个数据集上的计算性能指标

Table 6 Computational performance metrics of ResNet50, C-GhostNets,and G-GhostNets on three datasets

|

数据集 |

网络模型 |

参数量 (百万) |

计算量 (百万) |

推理 时间(秒) |

|

Pavia University |

ResNet50 |

23.578 |

162.02 |

0.074 |

|

|

C-GhostNets |

2.529 |

248.432 |

0.057 |

|

|

G-GhostNets |

1.489 |

117.936 |

0.013 |

|

Indian Pines |

ResNet50 |

23.634 |

167.496 |

0.082 |

|

|

C-GhostNets |

2.599 |

253.936 |

0.051 |

|

|

G-GhostNets |

1.519 |

120.68 |

0.012 |

|

Salinas |

ResNet50 |

23.651 |

167.75 |

0.056 |

|

|

C-GhostNets |

2.602 |

254.162 |

0.042 |

|

|

G-GhostNets |

1.521 |

120.792 |

0.009 |

图5 Pavia University数据的各类地物分类准确性

Fig.5 Per-class classification accuracy for the Pavia University dataset

图6 Indian Pines数据的各类地物分类准确性

Fig.6 Per-class classification accuracy for the Pavia University dataset

图7 Salinas数据的各类地物分类准确性

Fig.7 Per-class classification accuracy for the Salinas dataset

4.2 计算效率分析

从轻量化的角度看,G-GhostNets在推理时间、参数量和FLOPs 上的表现展示其设计的高效性。表6列出三个网络在Pavia University、Indian Pines以及Salinas数据集上的计算性能指标。G-GhostNets的参数量相较于C-GhostNets和ResNet50分别减少了22百万和1百万,计算量分别减少了约130百万和50百万,一次推理的时间分别减少了约0.06秒和0.04秒。进一步分析表明,G-GhostNets的轻量化优势得益于其G-Ghost Stage模块的设计,该模块通过特征分解与聚合策略优化了计算资源的使用效率。推理时间的显著减少反映了G-GhostNets在GPU环境下的并行计算优化能力,使其在对实时性需求较高的任务中展现显著优势。参数量的降低表明,G-GhostNets有效减少了模型复杂度,降低了存储和训练成本,这与轻量化网络的核心目标高度契合。计算量的大幅减少进一步验证了其在计算效率上的突破,体现了G-GhostNets在高维数据处理中的高效性。相较于C-GhostNets的单一特征提取路径和ResNet50的深层架构,G-GhostNets的设计更适配现代硬件环境,为高光谱图像分类任务在嵌入式设备和GPU上的高效部署提供了坚实基础。

5 结论

在嵌入式设备中部署深度学习模型以执行高光谱图像分类任务时,会面临参数量大和计算速度慢的问题。本研究主要针对GPU设备,提出了使用轻量化网络G-GhostNets,该网络同时考虑了图像的光谱特征和空间特征,并且采用聚合中间特征的G-Ghost Stage使模型在GPU上运行。实验结果表明,G-GhostNets在Pavia University、Indian Pines以及Salinas数据集上展现出优异的分类性能,相较于 C-GhostNets和ResNet50,其准确率和Kappa系数均实现显著提升,体现了在分类精度和类别均衡性上的卓越表现。同时,G-GhostNets在参数量、计算量和推理时间上实现了出色的轻量化,使其在GPU环境下的并行计算能力得以充分发挥,并展现了在嵌入式设备上部署的潜力,为资源受限场景提供了高效解决方案。

利益冲突: 作者声明没有利益冲突。

[⑤] 通讯作者 Corresponding author:常佩佩,3391732804@qq.com

收稿日期:2025-03-14; 录用日期:2025-03-19; 发表日期:2025-03-28

参考文献(References)

[1] Kang X, Li S, Benediktsson J A. Spectral-spatial hyperspectral image classification with edge-preserving filtering[J]. IEEE transactions on geoscience and remote sensing, 2013, 52(5): 2666-2677.

https://doi.org/10.1109/TGRS.2013.2264508

[2] Li S, Song W, Fang L, et al. Deep learning for hyperspectral image classification: An overview[J]. IEEE transactions on geoscience and remote sensing, 2019, 57(9): 6690-6709.

[3] 白林锋, 陈增俊, 周玲, 等. 深度学习赋能的高光谱图像分类研究进展[J]. 海军航空大学学报, 2024, 39(05): 535-545+586.

https://doi.org/10.7682/j.issn.2097-1427.2024.05.003

[4] Melgani F, Bruzzone L. Classification of hyperspectral remote sensing images with support vector machines[J]. IEEE Transactions on geoscience and remote sensing, 2004, 42(8): 1778-1790.

https://doi.org/10.1109/TGRS.2004.831865

[5] Li J, Bioucas-Dias J M, Plaza A. Semisupervised hyperspectral image segmentation using multinomial logistic regression with active learning[J]. IEEE Transactions on Geoscience and Remote Sensing, 2010, 48(11): 4085-4098.

https://doi.org/10.1109/TGRS.2010.2060550

[6] Licciardi G, Marpu P R, Chanussot J, et al. Linear versus nonlinear PCA for the classification of hyperspectral data based on the extended morphological profiles[J]. IEEE Geoscience and Remote Sensing Letters, 2011, 9(3): 447-451.

https://doi.org/10.1109/LGRS.2011.2172185

[7] Bandos T V, Bruzzone L, Camps-Valls G. Classification of hyperspectral images with regularized linear discriminant analysis[J]. IEEE Transactions on Geoscience and Remote Sensing, 2009, 47(3): 862-873.

[8] Ghamisi P, Maggiori E, Li S, et al. New frontiers in spectral- spatial hyperspectral image classification: The latest advances based on mathematical morphology, Markov random fields, segmentation, sparse representation, and deep learning[J]. IEEE geoscience and remote sensing magazine, 2018, 6(3): 10-43.

[9] 李子轩, 官云兰, 王楠, 等. 基于卷积神经网络的高光谱 图像分类[J]. 江西科学, 2025, 43(01): 26-35.

https://doi.org/10.13990/j.issn1001-3679.2025.01.004.

[10] Lv Z, Dong X M, Peng J, et al. ESSINet: Efficient spatial- spectral interaction network for hyperspectral image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 1-15.

DOI:10.1109/TGRS.2022.3162721

[11] Yao J, Cao X, Hong D, et al. Semi-active convolutional neural networks for hyperspectral image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 1-15.

DOI:10.1109/TGRS.2022.3206208

[12] Feng J, Zhao N, Shang R, et al. Self-supervised divideand- conquer generative adversarial network for classification of hyperspectral images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 1-17.

[13] Yang Y, Tang X, Zhang X, et al. Semi-supervised multiscale dynamic graph convolution network for hyperspectral image classification[J]. IEEE Transactions on Neural Networks and Learning Systems, 2022, 35(5): 6806-6820.

[14] Wang L, Wang L, Wang Q, et al. RSCNet: A residual self-calibrated network for hyperspectral image change detection[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 1-17.

[15] Howard A G, Zhu M, Chen B, et al. Mobilenets: Efficient convolutional neural networks for mobile vision applications[J]. arXiv preprint arXiv: 1704. 04861, 2017.

https://doi.org/10.48550/arXiv.1704.04861

[16] Zhang X, Zhou X, Lin M, et al. Shufflenet: An extremely efficient convolutional neural network for mobile devices[C]//Proceedings of the IEEE conference on computer vision and pattern recognition. 2018: 6848-6856.

[17] Han K, Wang Y, Tian Q, et al. Ghostnet: More features from cheap operations[C]//Proceedings of the IEEE/ CVF conference on computer vision and pattern recognition. 2020: 1580-1589.

[18] Kavitha K, Arivazhagan S, Suriya B. Classification of Pavia University hyperspectral image using Gabor and SVM classifier[J]. Int. J. New Trends Electron. Commun, 2014, 2(3): 9-14.

[19] Vishwanath V, Sreekanth K, Prakash J, et al. Hyperspectral Patterns With Deep Learning For Classification For Indian Pines[C]//2024 15th International Conference on Computing Communication and Networking Technologies(ICCCNT). IEEE, 2024: 1-7.

[20] 刘柏森, 刘志衡, 孔伟力. 一种自动编码机与K-means相结合的高光谱图像聚类方法[J]. 黑龙江工程学院学报, 2020, 34(06): 23-27+33.

https://doi.org/10.19352/j.cnki.issn1671-4679.2020.06.004.

Hyperspectral Image Classification Based on the Lightweight G-GhostNets Network

(Faculty of Information Science and Engineering, Ocean University of China, Qingdao 266100, China)

Abstract: Hyperspectral image classification (HSIC) has been widely applied in remote sensing image analysis. However, deploying deep learning models on embedded devices for HSIC tasks faces challenges due to excessive parameters and high computational complexity. To address these issues, this paper proposes the lightweight G-GhostNets network optimized for GPU devices. G-GhostNets effectively integrates both spectral and spatial features of hyperspectral images. By introducing the G-Ghost Stage, which aggregates intermediate features, the model achieves high-precision classification while maintaining computational efficiency on GPUs. To validate its performance, this study used ResNet50 and C-GhostNets as comparative networks and conducted classification experiments on preprocessed Pavia University, Indian Pines, and Salinas datasets, respectively. The experimental results demonstrate that G-GhostNets exhibits outstanding performance in HSIC tasks, delivering high accuracy and efficient GPU-based inference with significantly reduced computational time per class.

Keywords: Hyperspectral image classification, feature extraction, deep learning, lightweight networks

Citation: CHANG Peipei. Hyperspectral image classification based on the lightweight G-GhostNets network[J]. Acta Interdisciplinary Science, 2025, 2(1): 48-57.